2017

2017-01 Оцифровка 3D-объектов с помощью Remake

Про оцифровку с помощью Remake:

Снимал собаку при солнечном свете, на столе у окна, чтобы не было лишних бликов от ламп.

Поставил на разноцветную салфетку.

Успешная съемка была при использовании узкого объектива. Тогда только собака была в фокусе.

Обошел два раза кругом, а также снял точно сверху и спустился вбок.

(съемка с мобильного и с использованием широкоугольного объектива - не дали результата, программа восстановила окружение, а не саму собаку)

2017-02-04 Перформанс Рельеф Движения

Екатерина Жаринова, Наталья Бриль, Перформанс в Гуманитарном университете.

Запись движений вентилятора и воспроизведение, Ableton Live, два микрофона, LPD8,

Гранулярный синтез от колыханий ткани, Kinect 2, (в качестве источника звука - музыка Leksha)

2017-02-11 Техноночь

в Технопарке Университетский, http://www.uralhitech.ru/

На Техноночи был показ нескольких проектов, созданных преподавателем ЕАСИ Д.С.Переваловым совместно со студентами.

1) Работа Насти Киприяновой (ПИ-4) Эксперимент "Темная комната".

В темной комнате был подвешен источник света, и каждому желающему предлагалось надеть темные очки, оснащенные датчиком света и связанным с ним вибромоторчиком. Требовалось решить задачу - найти "вслепую" в комнате расположение света, ориентируясь только на работу вибромоторчика вместо глаз.

Этот эксперимент является частью ВКР (руководитель Д.С.Перевалов), которая реализуется совместно с творческим союзом СоБытие (г. Екатеринбург), занимающееся инклюзивными технологиями в арт-перформансах.

2) Проект Марины Ширан (ПИ-4) "Полет-А".

Полет над пространством абстрактного искусства. Проект реализован с помощью игрового движка Unreal Engine. Это часть ВКР, руководитель Д.С.Перевалов. В реализации участвовали доц. А.А.Егорова, а также студенты ЕАСИ Егор Пажунин и Татьяна Плотникова.

3) Проект Вероники Белогруд "Алмазики" (ПИ-4)

Это инсталляция, состоящая из горизонтально закрепленного компьютерного монитора и веб-камеры, закрепленной над ним.

Зрители выкладывают на экран полупрозрачные разноцветные камешки, а на экране от них разлетаются частицы.

Веронике принадлежит идея и прототипная реализация проекта, а финальный вариант реализован Д.С.Переваловым.

4) Проект Д.С.Перевалова "Светорисование".

В этой инсталляции одному зрителю предлагается встать у стены, а другому водить по нему светом фонарика. На соседней стене от света "проявляется" изображение, подобно проявке аналоговой фотопленки, только здесь это реализовано с помощью веб-камеры и проектора.

Идея такого рисования принадлежит Татьяне Кукарцевой и Анне Воронцовой (ПИ-2).

5) Проект Kuflex "Эхо сэмплер" https://dhta.blog/2017/02/12/echo-sampler-musical-instrument/

6) Проект Kuflex "Атомная фотобудка"

2017-02-16 Статьи к конференции Открытый Город 2016 (ЕАСИ)

Исследовательские статьи (сбор материалов) со студентами ЕАСИ про мобильные проекции, telepresense, 3D картины и свет в танцевальных выступлениях.

1) Данчук Ю.С., Перевалов Д.С., ПРОЕКТЫ TELEPRESENSE В ОТКРЫТЫХ ПРОСТРАНСТВАХ

2) Задорина А.П., Перевалов Д.С., МОБИЛЬНЫЕ ПРОЕКЦИИ В ГОРОДСКИХ ПРОСТРАНСТВАХ

3) Мазалов П.В., Перевалов Д.С., ТАНЕЦ И СВЕТ НА ОТКРЫТЫХ ПРОСТРАНСТВАХ

4) Ширан М.В., Перевалов Д.С., ИСПОЛЬЗОВАНИЕ ИМИТАЦИОННОГО МОДЕЛИРОВАНИЯ ДЛЯ СОЗДАНИЯ СКУЛЬПТУРНОГО ПАБЛИК-АРТА

5) Перевалов Д.С, Кукарцева Т.А., Интерактивный паблик-арт: существующие и возможные типы взаимодействия (только презентация)

2017-02-20 Домашняя репетиция Kuflex, Стереоблины

https://www.youtube.com/watch?v=t9UQ6Uzciys

2 марта четверг Съемка репортажа "Смешанная реальность" для канала Технофак

Съёмка с Ульяной Долгиной в ЕАСИ.

Смешанная реальность - между физической и виртуальной. Добавляет к реальным объектам виртуальное цифровое изображение и получается синхронизация реального объекта с окружающим его изображением, когда вокруг реальных объектов на поверности дорисовываются его следы или другие цифровые артефакты, либо изображение на самом объекте. Сейчас осуществляется с помощью проектора, или экрана. Основное внимание уделил процессу быстрой калибровки.

- 2D случай, дополнение реального объекта виртуальным окружением. На примере 2D-случая, когда объект можно считать плоским и он движется в плоскости. Можно осуществить обычной веб-камерой, калибровав по 4-м точкам (углы изображения)

- Динамический мэппинг, то есть видеомэппинг на поверхность движущегося объекта. проецируется изображение с помощью проектора. Можно осуществить с помощью камеры глубины типа Kinect (использовали в репортаже Kinect2). Я рассказал про новый способ калибровки по 6 точкам: углы проекции (когда работаем у стены, это углы картинки с проектора, иначе - подставляем лист бумаги и ловим углы сетки, выдаваемой проектором), центр проекции, и еще одна точка из центра проекции, которая расположена на некотором удалении от первой (0.5-1 м). Также, для калибровки требуется знание о расстоянии от проектора до центра проекции. В процессе калибровки камера глубины считывает расстояния до всех 6 точек и по ним строит модель проектора - его расположение в пространстве. Такой метод позволяет нам за несколько минут калибровать камеруи проектор перед выступлениями. Он реализован в программе KuStar, которую мы разработали для концерта Барокко и используем в последующих работах.

2017-03-05 Перформанс Погружение с Таней Просто

ГЦСИ, 5 марта, Екатеринбург

https://www.youtube.com/watch?v=hwFYmCADlNc

Звук в Pogr Sampler

Генерация звука осуществлялась в программе PogrSampler, написанной для этого перформанса, на openFrameworks. Программа улавливала нажатия педали на пульте APC40 (как миди устройство, с помощью аддона ofxMidi), и записывала фрагмент звука для последущей обработки.

Было 6 каналов звука. Для каждого канала программа хранила презеты обработки, и каждый записанный звук попадал на одну из этих дорожек.

Переключение презетов осуществлялось с помощью пульта Novation Launchpad Mini (8x8 квадратны кнопок в центре, и еще по периметру круглые кнопки). Имеется режим автоперехода - когда после записи звука программа переходит на следующий канал/презет.

Визуально презеты располагались по 6 штук в ряд:

1 2 3 4 5 6

7 8 9 10 11 12

...

41 42 43 44 45 46 47 48

Имелось 2 страницы презетов, по 6x8 странице - то есть 96 штук.

В одном стихе выделалось 3 слова.

Было три режима обработки звука:

- Delay - просто повтор с заданной задержкой (в битах, темп был фиксированный 120 BPM)

- Grain - гранулярный повтор (задавалась задержка повторов, начала и длительность воспроизводимого кусочка сэмпла, длительность гранулы и общая скорость воспроизведения сэмпла). Гранулярный синтез был сделан с прямоугольными гранулами, поэтому он звучал довольно резко.

- Spectr - спектральный повтор (задавалась скорость воспроизведения, а также начало и длительность фрагмента воспроизводимого сэмпла). Реализация была сделана с помощью алгоритма фазового вокодера, то есть с помощью спектральной обработки, а именно, оконного преобразования Фурье. В фазовом вокодере где-то закралась ошибка, и он также звучал достаточно резко.

Громкость и панорама имели LFO, с задаваемым размахом и длиной цикла (в битах 120 BPM). Типы LFO:

- const - без изменений

- rand - случайные значения

- up, down - вверх и вниз

- sin, -sin, cos, -cos - гармонические колебания.

Значение LFO генерировалось в момент запуска нового сэмпла (кроме спектрального - в нем только при инициализации).

Доработки: сделать спектральный повтор с возможностью перезапуска звука. Добавить новые генераторы - гранулярный синтез волны, спектральную обработку всего сэмпла как в программе Mammut, задание огибающей громкости и фильтра для имитации реальных звуков типа биения сердца.

Также, программа высылала по OSC в Ableton данные о громкости, трех sends (реверберация, делэй, делей с фленжером), а также 8 параметров звуковой обработки каждого трека.

В проекте PogrSampler использовались следующие аддоны openFrameworks:

ofxAbletonLive - для связи с Ableton (аддон был расширен)

ofxFft - для реализации фазового вокодера

ofxKuTextGui - наш аддон для текстового интерфейса

ofxMidi - для работы с MIDI-устройствами (пульты APC40 и LPD8)

ofxOsc - требуется для ofxAbletonLive

Звук в Ableton

Ableton Live 9 Suite использовался как обработчик звука - он обрабатывал микрофон, посылал звук в PogrSampler, принимал звуки и обрабатывал их (см. ниже про виртуальные звуковые каналы).

В настройках проекта Ableton использовалось три канала SENDS:

- реверберация

- повторы (delay)

- повторы с фазером (delay+phaser) для "разгона"

На каждом из 6 каналов стоял 3-канальный эквалайзер и эффект Sweep+Reverb. Их параметры упралялись 8-ю ручками управления на APC40.

Для обмена данными с PogrSampler в Ableton было необходимо установить плагин LiveOSC в Ableton.

Виртуальные звуковые каналы

Для обмена звуком между oF и Ableton - требовалось 18 каналов. Ниже рассказывается, как это было сделано на OSX.

- 1,2 Внешняя звуковая карта Scarlett - 2 входа/2 выхода. Вход с микрофона FocusRite 2x2 Scarlett обрабатывался Ableton и выдавался в выход, а также в каналы 3,4.

- 3,4 Результат предобработки микрофона в Ableton

- 5,6 Первый трек

- 7,8

- 9,10

- 11,12

- 13,14

- 15,16

- 17,18

Для организации этого купил сначала LoopBack 99$, OSX - но оказалось, что дает треск при большом числе каналов и при работе с Pogr.

В итоге, использовал бесплатную программу SoundFlower.

На звуковой карте было создано агрегатное звуковое устройство из Scarlett и Sound Flower 64 канала, с помощью встроенной в OSX программы Audio MIDI Setup.

Особенности:

- По какой-то причине, каналы 3,4 не работали - поэтому в PogrSampler посылался сырой звук микрофона (канал 1).

- После кажого подключения внешней звуковой карты FocusRite приходилось выключать и снова включать устройства в настройках агрегатного звукового устройства.

Визуализация

Использовалось два проектора - подвешенный к потолку для освещения стены, и установленный на полу для освещения ткани натягиваемой во второй части перформанса (белая мелкая стретч-сетка 6x6 метров, сшитая из 1.5-метровых полос).

Для надежности каждый проектор управлялся отдельным компьютером.

Программы, работающие на компьютере для основного проектора:

- KuStar - получение данных с Kinect 2, вычислеие маски человека, отправка маски на KuPlay

- Kuplay - рендеринг данных в виде "дыма" от маски человека на сцене

- Transcode - захват звука с микрофона (встроенного) и генерация изображения транскодинга

- VDMX - сбор видео каналов с KuPlay и Transcode, воспроизведение предзаготовленны наложение эффектов, вывод на проектор. Управление осуществлялось пультом Akai LPD8.

На компьютере, выдающем изображение на ткань, использовался VDMX, который выдавал изображение заранее подготовленного видео.

Особенности: во время выступления KuStar несколько раз прекратил работу (перестали приходить данные с кинекта). Поэтому, приходилось его перезагружать. Связываю это с тем, что KuStar и VDMX требовали для работы много ресурсов видеокарты, которых не хватало.

Подготовка футажей

Для снижения нагрузки на рендер и упрощения управления, я отсчитал около часа футажей по 2-3 минуты для главного проектора. (А 15 минутное видео для ткани - использовалось из Погружения 2014 года.)

Для футажей использовалась программа Kusmos - это 4-канальный видеосинтезатор, который мы разработали в 2015 году для визуализации премьеры концерта группы СБПЧ "Здесь и сейчас".

Синтезатор работает с тремя типами объектов:

- 3D-модели в виде OBJ-файла

- генератор движущегося облака точек (для имитации звезд, полета через космическое прогстранство)

- данные с кинект

Синтезатор позволяет независимо управлять четырьмя объектами, путем настройки следующих параметров:

перемещать, вращать, менять размер объектов,

настраивать режим показа (точки, линии, треугольники),

менять число показываемых элементов (для прореживания с возникновением "дырок"),

выбирать текстуру, сдвигать текстурные координаты,

накладывать шум Перлина (по трем координатам, либо радиальный от центра объекта).

Управление осуществляется через OSC (обычно из программы VDMX)

Результат посылается по 4-м каналам Syphon (обычно в VDMX, где он микшируется и посылается на проектор или экран).

Данные с кинектов приходят по сети, до 4-х кинектов (кинекты расположены у сцены, а компьютер-рендер за сценой, поэтому кинекты подключались к компьютерам, которые передавали данные по сети в рендер)

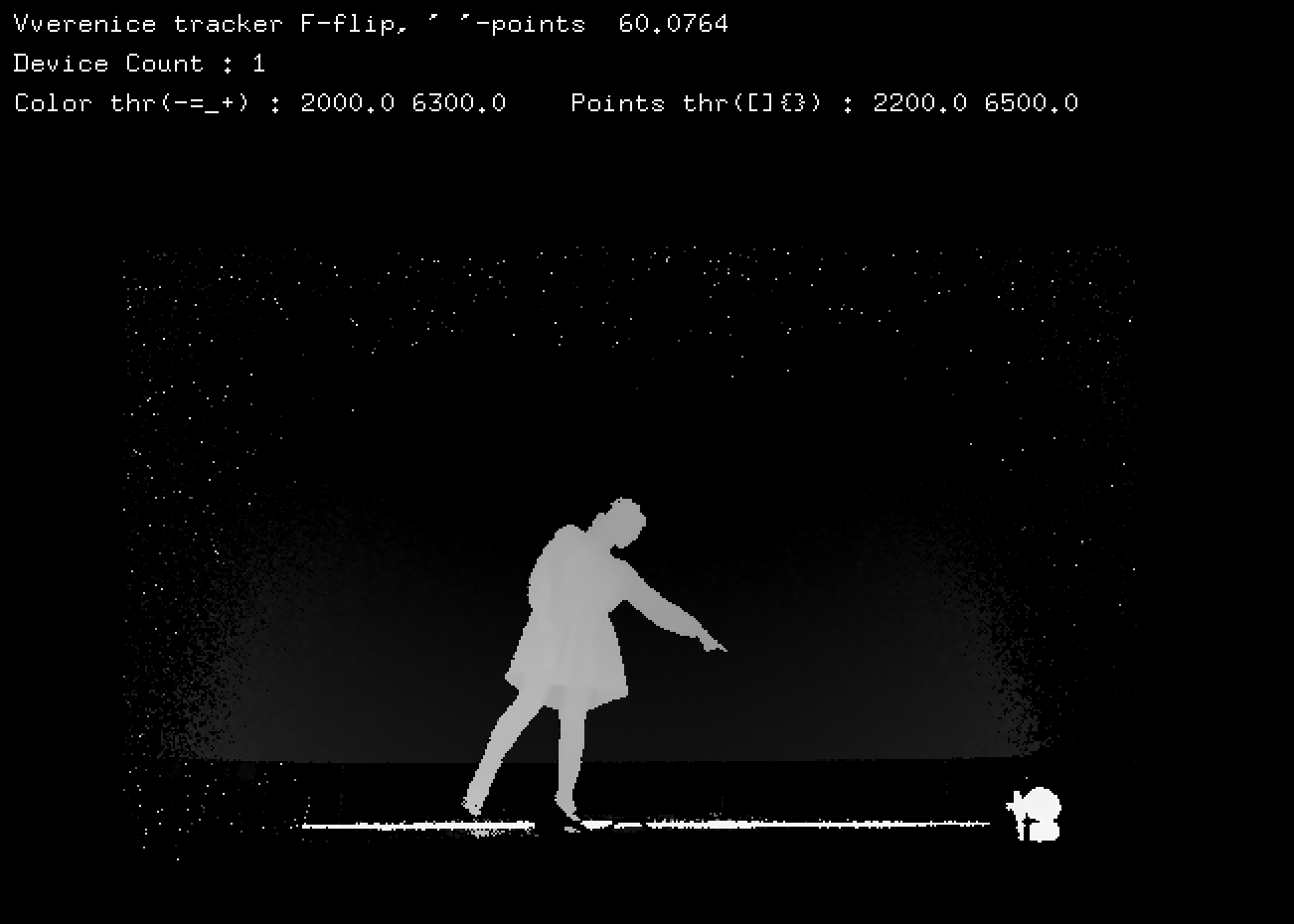

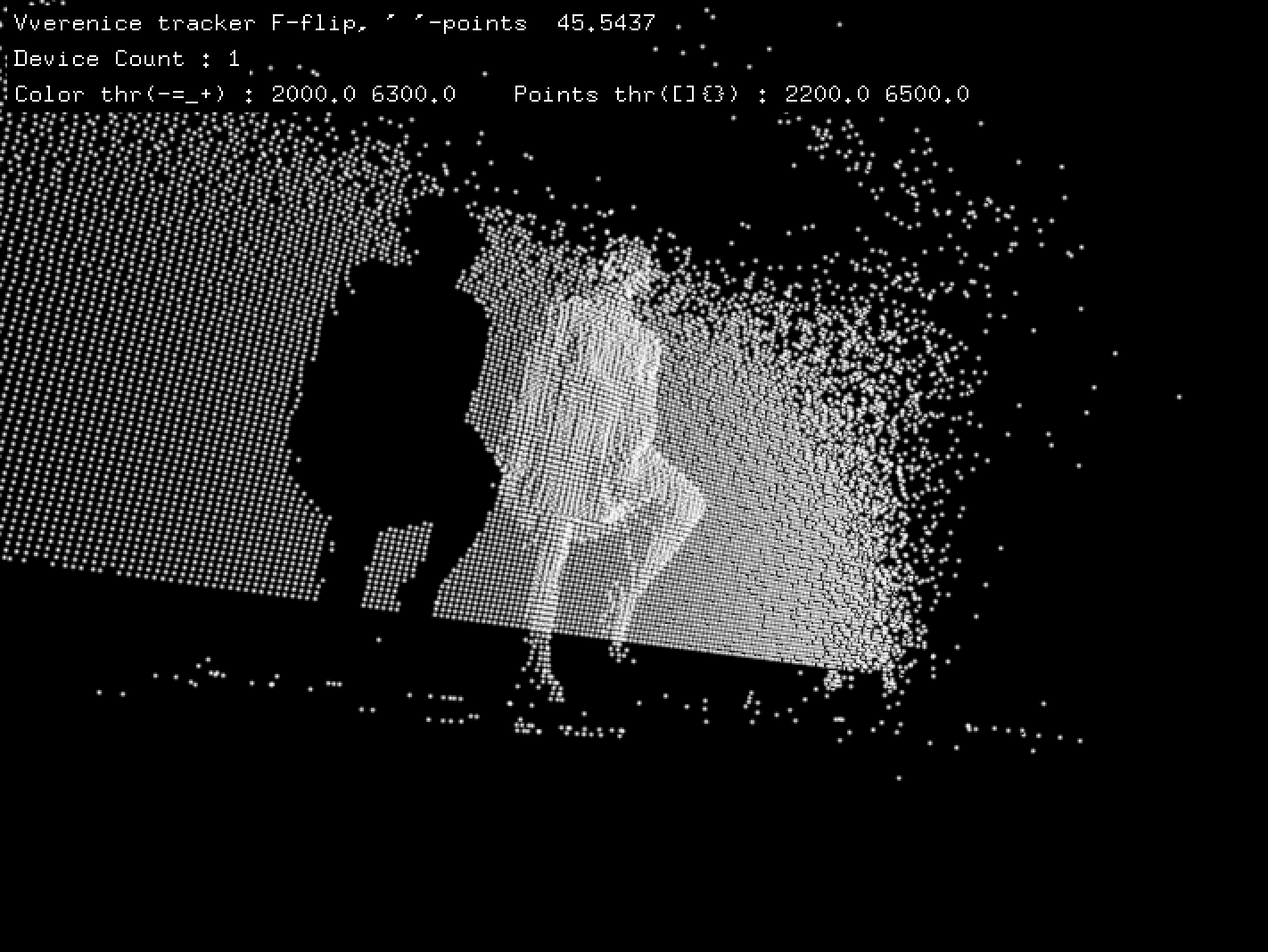

2017-03-06 ВВеренице в Ельцин Центре

Вечер одноактных танцевальных спектаклей и перформансов

ВВеренице состоит из 4-х программ:

1) KuStudio - воспроизводит звуки и осуществляет тайминг, параметры посылает в VVerenice_Render

2) KuTracker - захват данных с кинекта, посылает данные в VVerenice_Render (Kinect V2)

3) VVerenice_Render - рендер цифр и видеолуперы (повторители)

4) VDMX - получает видео из VVerenice_Render, накладывает картинку сетки, делает инверсию и выводит на экран

VDMX - покупная, остальные сами делали

15 марта, Лекция "Танцевальные перформансы с визуальным рядом и интерактивностью"

Екатерина Жаринова, Денис Перевалов

Лекция адресована студентам Факультета современного танца Гуманитарного университета

ФАКУЛЬТЕТ СОВРЕМЕННОГО ТАНЦА Адрес: Железнодорожников 3, ауд. 103.

июнь Выставка Kuflex #1 в Абрау Дюрсо

We are [**Kuflex**](http://kuflex.com\.

Now we opened an exhibition Kuflex #1 at gallery Media Art Abrau ([**Abrau Durso**](https://en.wikipedia.org/wiki/Abrau-Dyurso\ and sound.

https://www.slideshare.net/perevalovds/kuflex-1-exhibition

Projects, as they shown in video:

Portal (big LED display + mirrors, Xtion; pure oF)

Another Land (projectors, Xtions; oF + Unreal Engine 4)

Constellations (projector + holographic meshes; Xtion, PC; pure oF)

Quantum Space (projectors, Xtions; oF + Max/MSP)

Scanner (LED TV, 1 Kinect v2; pure oF)

Moths (projector, Xtion; pure oF)

Simbiosys (projectors, Xtions; pure oF)

Speed of Color (projectors, Xtions; of + Unreal Engine 4)

We published the oF-addons and functions which were used extensively in this projects:

* [**ofxKuTextGui**](https://github.com/perevalovds/ofxKuTextGui\, which saves so much time for us. Also, up to 16 programs made with ofxKuTextGui can be controlled remotely via OSC, using [**KuRemote**](https://github.com/kuflex/KuRemote\ project. This, again, saves a lots of time when tuning up mapping and other parameters across all installations.

* [**ofxKu**](https://github.com/kuflex/ofxKu\

* [**ofxKuBox2d**](https://github.com/kuflex/ofxKuBox2d\ - addon for Box2D library especially intended for simulating physics with Kinect masks. It is used as a main part for creating interactivity in Another Land project.

* [**ofxKuNetwork**](https://github.com/kuflex/ofxKuNetwork\ - wrapper over ofxNetwork oF core addon, intended for sending and receiving data arrays over network. It is used in all "big" installations - Quantum Space, Another Land, Simbiosys, for transferring data from "Tracker" computer (controlling Kinects/Asus Xtions) to "Render" computer (performing actual rendering on the screen).

Two projects (Another Land and Speed of Color) use not oF, but Unreal Engine 4 for rendering, whereas capturing data from depth cameras and modelling physics performed using oF. Control information from oF-programs is sent to Unreal project using our plugins for Unreal Engine (will be published soon).

One plugin sets positions of objects in Unreal scene (in Another Land), and another plugin sets content of texture (in Speed of Color). Plugins are based on this [**code for creating texture**](https://github.com/kuflex/UnrealCPP\ in Unreal Engine 4.

We will be happy give more detailed information on projects. Also we are ready to teach oF and UE on master-classes (English language) and looking for collaborations all around the world :slight_smile: